KI im Engineering – Praxis und Grenzen

Lesen Sie diesen Artikel auch im E-Paper der Technischen Rundschau: Technische Rundschau 4/2026

Als Embedded‑Software‑Ingenieurin nutze ich täglich KI‑Assistenten in meiner Entwicklungsumgebung. Sie generieren einfachen Code weit schneller, als ich ihn schreiben könnte, unterstützen mich beim Deuten von Fehlermeldungen und schlagen präzise Lösungsansätze vor. Mit einem Review‑Agenten, der meine Arbeit nach einem klar definierten Vorgehen und mit unterschiedlichen Personas prüft, habe ich meinen Aufwand für Selbst‑Reviews reduziert und gleichzeitig deren Qualität gesteigert. Allerdings zeigen diese Modelle trotz der strukturierten Methode immer wieder Ergebnisse, die zwar plausibel wirken, im Detail jedoch nicht stimmen. Sie benötigen Führung – besonders in spezialisierten Fachgebieten. Meine Erfahrung beschränkt sich auf die Software. Zwei Kollegen bei Zühlke haben untersucht, wie sich KI‑Werkzeuge in der Hardwareentwicklung schlagen.

Der KI‑Copilot im Test

Florian Krischker hat Flux AI evaluiert, eine cloudbasierte Elektronik‑Designplattform, deren KI‑Copilot den Anwender von der Anforderungserfassung bis zum Schaltplanentwurf und PCB‑Layout unterstützt. Krischker testete das System an realen Projekten, darunter einen Überspannungsschutz für eigensichere Anwendungen sowie ein BLE/LoRaWAN‑Gerät mit langer Batterielebensdauer. In frühen Projektphasen überzeugt das System. Anforderungen lassen sich in natürlicher Sprache verfeinern, und der Copilot schlägt Blockdiagramme, Architekturvarianten und Bauteile vor. Je näher ein Projekt am Mainstream liegt, desto brauchbarer die Vorschläge. Beim Überspannungsschutz identifizierte er ein alternatives Back‑to‑Back‑MOSFET‑Konzept anstelle der geplanten Crowbar‑Schaltung, bei dem die Sekundärseite nur versorgt wird, wenn die Schutzschaltung aktiv ist. Bei sicherheitskritischen Designs zeigte sich allerdings, dass der Copilot Standards wie IECEx, ATEX und NEC zwar kennt, aber grundlegende Anforderungen nicht korrekt berücksichtigt. Die grössten Schwächen treten bei der Schaltplangenerierung auf: fehlende Abblockkondensatoren, falsche Pinverbindungen, kaum lesbare Netze, selbst kurzgeschlossene Widerstände. Die manuelle Bereinigung war deutlich schneller und zuverlässiger als der Copilot. Krischker zieht eine Parallele zum «Vibe Coding»: KI beschleunigt Exploration und erste Entwürfe, aber Korrektheit und Qualität hängen von menschlicher Führung ab. Sein Fazit: KI wirkt als Multiplikator für Erfahrung, nicht als Ersatz.

5 Volt sind keine 5,7 Volt

In der Produktentwicklung durchlaufen Designs vor der Fertigung mehrere Review‑Runden, in denen Fachpersonen Schaltungen prüfen und mit Datenblättern abgleichen. Ein zeitaufwendiger, fehleranfälliger Prozess. Jonathan Hendriks startete deshalb mit einer ambitionierten Vision: Kundenanforderungen und Schaltpläne einspeisen, per KI gegen relevante Normen prüfen und daraus weitere Anforderungen ableiten. Daraus wurde zunächst ein Datenextraktionsprojekt. Denn bevor KI Normen prüfen kann, muss sie Datenblätter zuverlässig lesen können. Das ist schwieriger als erwartet. Datenblätter sind PDF‑Dateien mit heterogenen Layouts: Hochformat, Querformat, Tabellen neben Grafiken, unterschiedlichste Strukturen. Lässt man ein KI‑Sprachmodell direkt auf ein 178‑seitiges Datenblatt los, halluziniert es. Aus 5 Volt werden 5,7 Volt. In der Elektronikentwicklung ist das nicht tolerierbar.

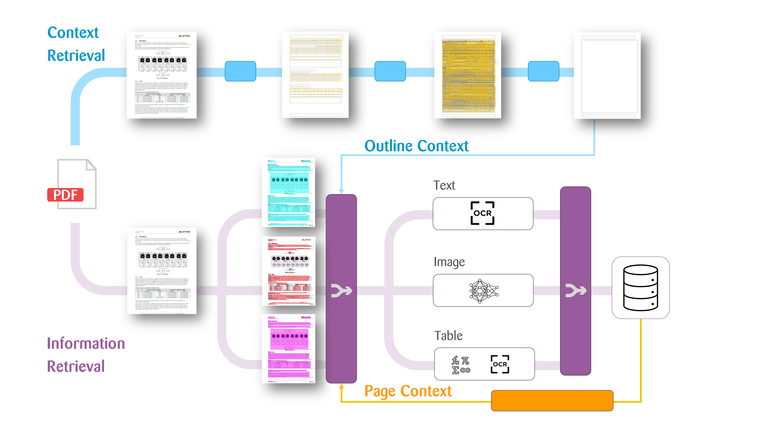

Hendriks’ Ansatz ist strukturierter (Siehe Bild): Zuerst wird das Layout analysiert, dann werden Seiten in einzelne Boxen zerlegt – Text hier, Tabelle dort, Grafik woanders. Für einfache Textblöcke reicht optische Zeichenerkennung (OCR), bei Tabellen wird es schwieriger. Hendriks ist damit nicht allein: Ein Kollege versuchte einen anderen Weg und liess zuerst das Inhaltsverzeichnis einlesen, um nur relevante Abschnitte zu extrahieren. Auch das lieferte keine durchgehend zuverlässigen Resultate. Das grundlegende Problem: KI‑Modelle sind nicht deterministisch. Je komplexer der Aufruf, desto unterschiedlicher die Ergebnisse. Doch Hendriks stellt eine grundlegendere Frage: Sollten Hersteller und Behörden nicht direkt maschinenlesbare Formate liefern statt PDFs?

Ersetzt KI den Ingenieurberuf?

In der Software‑ wie in der Hardwareentwicklung zeigt sich dasselbe Muster: KI‑Werkzeuge entfalten ihren Nutzen in der Exploration und Strukturierung. Sobald Präzision und Normenkonformität gefragt sind, bleibt die Verantwortung bei den Fachpersonen. Die Technologie entwickelt sich rasant. Die Einschränkungen von heute werden schon bald von neuen abgelöst. Viele Fachleute beschäftigen sich derzeit mit denselben Herausforderungen. Gelegenheit zum Austausch bietet die Veranstaltung von FAEL und der Fachgruppe Artificial Intelligence am 22. April 2026 in Schlieren: «Ersetzt KI den Ingenieurberuf?» Philipp Morf entwirft ein Zukunftsbild der Partnerschaft von Mensch und Maschine. Sascha Jecklin beleuchtet, warum KI‑Sicherheit Ingenieurskompetenz braucht. Marco Schmid plädiert für Deep Work als Gegenpol zum ständigen Rauschen. Romano Roth zeigt mit konkreten Beispielen, wo KI im Engineering zuverlässig Nutzen bringt und wo sie scheitert. Céline Heldner demonstriert automatisierte Konformitäts‑Checks in der Medizintechnik.

Beitrag von: Belinda Kneubühler (FAEL), Florian Krischker (Zühlke), Jonathan Hendriks (Zühlke)

Bildquelle: FAEL, Zühlke